La profundidad de una web es uno de esos factores SEO que rara vez se explican bien, pero que impactan directamente en el rastreo, la indexación y la experiencia del usuario. Cuanto más “enterrado” está un contenido dentro de la arquitectura, más difícil es para Google acceder a él y entender su relevancia dentro del sitio. Por eso, analizar los niveles de profundidad es clave para que tus URLs estratégicas no queden invisibles a ojos del buscador.

Una estructura clara, lógica y de pocos clics no solo facilita el trabajo de los bots, sino que también mejora la usabilidad y la conversión. El objetivo es simple: que cualquier contenido importante se pueda alcanzar en el menor número de pasos posible.

Entender cómo organizar los niveles de profundidad y cuándo ampliarlos o reducirlos es parte de una arquitectura SEO sólida que impulsa rendimiento real. Ya sea que tienes un Ecommerce, revista o una agencia de linkbuilding esta guía te ayudará (y mucho) a entender los niveles de profundidad de una web y cómo trabajarlos

Qué es la profundidad de una web en SEO

La profundidad de una web hace referencia al número de clics necesarios para llegar desde la página principal (home) hasta cualquier URL interna del sitio. Se mide en niveles: una página a un clic de distancia está en nivel 1, una a dos clics en nivel 2, y así sucesivamente.

Este concepto forma parte de la arquitectura SEO y determina qué tan accesible resulta el contenido tanto para los usuarios como para los bots de los motores de búsqueda.

En términos prácticos, la profundidad establece la “jerarquía” real de tu sitio, mucho más que el simple menú principal. Un contenido relevante, transaccional o con potencial de posicionamiento nunca debería perderse en niveles profundos (nivel 4, 5, 6…) porque ese “enterramiento” limita sus oportunidades de ser descubierto.

Por eso, reducir profundidad o distribuir mejor los enlaces internos es clave para que los bots encuentren, rastreen y valoren las URLs importantes. En resumen: la profundidad no es solo un concepto técnico; es un indicador directo de la salud estructural de tu web.

Por qué importa la profundidad en el rastreo

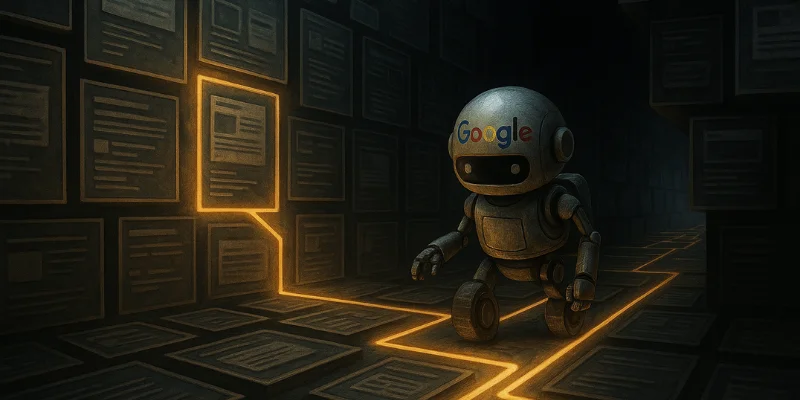

Google rastrea la web con un presupuesto limitado (crawl budget), lo que significa que no todas las páginas reciben la misma frecuencia o prioridad. Cuanto mayor sea la profundidad, más difícil será para los bots llegar a una URL, entender su valor y actualizar su contenido en el índice.

Las páginas muy profundas se consideran menos relevantes, porque la web está comunicando a través de su estructura que requieren demasiado esfuerzo para ser alcanzadas.

Además, la profundidad influye en cómo se distribuye la autoridad interna. Las páginas cercanas a la home suelen recibir más enlaces, más fuerza y más relevancia, mientras que las más profundas quedan aisladas, con menor peso interno y menos posibilidades de posicionar. Esto afecta especialmente a:

- Categorías importantes de un e-commerce

- Artículos evergreen que deberían traer tráfico constante

- Landing pages estratégicas

- Contenidos que dependen de señales de frescura

En pocas palabras: si Google tarda más en llegar, identificar y entender una página, esa página pierde competitividad. Mantener una profundidad óptima mejora rastreo, indexación y posicionamiento.

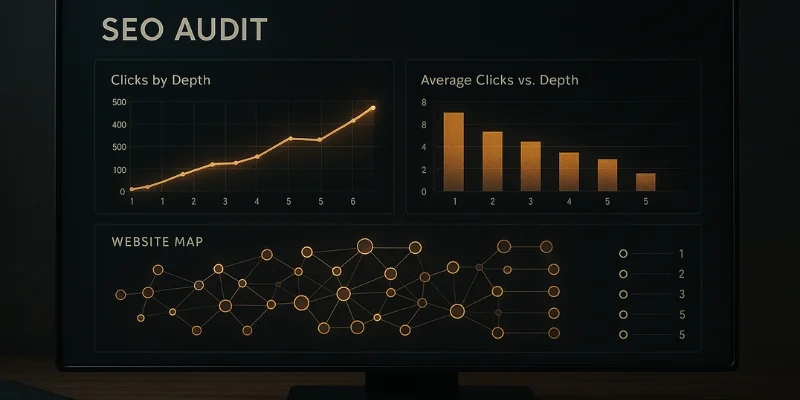

Cómo medir la profundidad de tus páginas

Medir la profundidad de una web es un proceso técnico, pero muy accesible con las herramientas correctas. La forma más precisa es usar un crawler como Screaming Frog, Sitebulb, JetOctopus o Ahrefs Site Audit.

Al rastrear tu sitio, estas herramientas muestran cuántos clics separan cada URL de la home y agrupan el contenido por niveles. Esto te permite detectar:

- Páginas críticas enterradas en niveles 4+

- Zonas del sitio con estructura débil o poco enlazada

- Exceso de profundidad causado por filtros, paginaciones o rutas de navegación pobres

- Secciones completas ignoradas por Google

Otra forma complementaria de medir profundidad es analizar la estructura de enlaces internos. Si una URL aparece enlazada desde múltiples lugares relevantes (menú, sidebar, artículos relacionados, breadcrumbs), su profundidad real disminuye aunque esté físicamente dentro de una ruta más larga. Por eso, es clave revisar no solo la arquitectura, sino cómo fluye el “camino de clics” mediante interlinking.

Idealmente, las páginas estratégicas deberían situarse entre los niveles 1, 2 y 3, reservando niveles más profundos para contenido residual, archivos o URLs de baja prioridad. Entender y medir esa profundidad te permite optimizar la accesibilidad de todo el sitio y facilitar el trabajo de los motores de búsqueda.

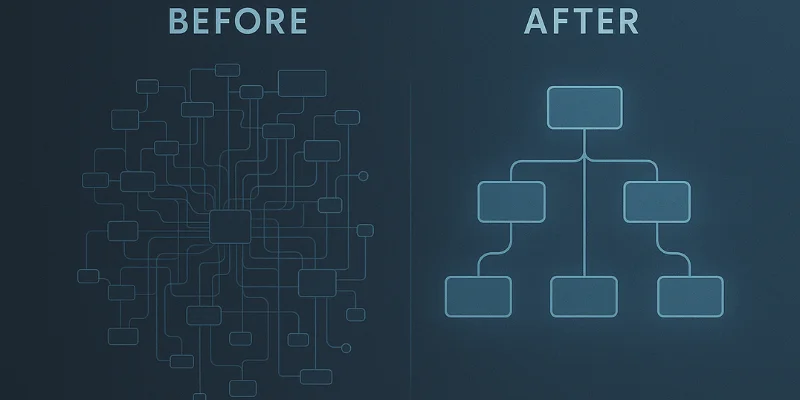

Buenas prácticas para reducir niveles innecesarios

Reducir niveles innecesarios es uno de los ajustes más rentables dentro de la arquitectura SEO, porque mejora simultáneamente rastreo, indexación, autoridad interna y usabilidad. Este proceso no consiste simplemente en “acercar” páginas a la home, sino en rediseñar el flujo de clics y la relación lógica entre contenidos para que Google pueda entender qué es importante y qué no. A continuación, se desarrollan las mejores prácticas de forma amplia, explicando no solo qué hacer, sino por qué funciona.

Una de las claves más efectivas es fortalecer el enlazado interno estratégico. Cada enlace bien colocado reduce profundidad real sin necesidad de modificar la estructura física del sitio.

Por ejemplo, si un artículo clave se encuentra en un nivel 4, basta con enlazarlo desde una categoría principal o desde una sección destacada del blog para convertirlo en una URL de nivel 2 desde la perspectiva del bot. El objetivo es crear caminos alternativos, eficientes y semánticamente coherentes para que los motores de búsqueda accedan al contenido más rápido.

Otra práctica esencial es revisar y optimizar la navegación principal (menú). Muchos sitios subestiman el valor del menú como vector de autoridad interna: añadir categorías relevantes, accesos directos a landings de negocio y rutas claras reduce significativamente la profundidad.

Esto también mejora la experiencia del usuario, que navega con menos fricción y encuentra antes lo que necesita. El menú es una declaración explícita de prioridades para Google; si algo es importante, debe verse arriba.

Las miguitas de pan (breadcrumbs) son otro recurso crítico. No solo ayudan a los usuarios a orientarse, sino que también crean rutas jerárquicas claras que Google entiende como “caminos” oficiales del sitio. Activar breadcrumbs reduce profundidad percibida, refuerza la categorización y facilita que los bots identifiquen conexiones entre contenidos emparentados.

Además, es fundamental evitar la creación de cadenas de categorías o subcategorías innecesarias. Muchos sitios caen en el error de agregar niveles como /categoria/subcategoria/tipo/variante/, cuando en realidad el contenido podría estar perfectamente dentro de una estructura de dos niveles.

Simplificar rutas reduce clics, carga cognitiva y dispersión de autoridad. De hecho, Google recomienda estructuras llanas para mejorar descubrimiento y rastreo.

Otro punto esencial es limitar paginaciones profundas, especialmente en e-commerce y blogs masivos. Si los productos o artículos importantes quedan enterrados en la página 20 de una paginación, Google tardará más en encontrarlos.

Soluciones como enlaces a “productos destacados”, filtros indexables bien controlados, o enlaces cruzados dentro de listados ayudan a que los bots alcancen el contenido sin depender de un scroll interminable.

No hay que olvidar que hay que revisar los parámetros que generan URLs sin valor y que provocan niveles falsos, como páginas filtradas sin contenido, duplicados o rutas inalcanzables. La limpieza técnica del sitio siempre repercute en una reducción de profundidad efectiva.

Arquitecturas ideales para sitios grandes

En sitios grandes e-commerce, medios de comunicación, marketplaces, webs corporativas complejas la arquitectura es un factor decisivo para el éxito SEO. Cuando el volumen supera cientos o miles de URLs, una estructura improvisada destruye rastreo, fragmenta autoridad y genera zonas muertas difíciles de indexar. Por eso, es esencial definir arquitecturas pensadas para escalar.

La base de una arquitectura ideal en sitios grandes es el modelo “flat-first”: intentar que las páginas más importantes estén como máximo a 3 clics de la home. Esto se logra mediante categorías fuertes, enlaces horizontales entre secciones y un menú cuidadosamente diseñado.

Las categorías deben segmentar el contenido con precisión, sin redundancia, evitando taxonomías infladas que confunden a los bots y a los usuarios. Una mala categorización crea niveles de profundidad innecesarios; una buena categorización los elimina.

En e-commerce, la arquitectura óptima suele ser Home → Categoría → Subcategoría → Producto, pero incluso este modelo tradicional puede optimizarse. Algunas tiendas reducen la profundidad enlazando productos destacados directamente desde categorías principales, creando hubs temáticos, o añadiendo accesos directos como “más vendidos”, “novedades” o “colecciones especiales”, que permiten sacar productos del fondo de la arquitectura sin romper la estructura lógica.

En medios grandes, una arquitectura ideal se apoya en clusters de contenidos o silos temáticos. Cada tema central actúa como un “hub” que unifica contenido relacionado. Esto reduce niveles, aumenta cohesión y distribuye autoridad entre piezas complementarias.

En una arquitectura así, cada contenido tiene un propósito dentro del ecosistema, y Google lo interpreta como un entorno bien organizado, fácil de rastrear y con relevancia temática sólida.

Las arquitecturas en malla (mesh architecture) también son extremadamente efectivas en sitios grandes. En lugar de depender únicamente de rutas verticales (categoría → contenido), se añaden enlaces horizontales y transversales que conectan páginas del mismo nivel.

Este sistema crea redundancia positiva: múltiples caminos llevan a la misma URL, reduciendo profundidad y aumentando rastreo. Es muy útil en webs con muchas fichas, artículos o variaciones de contenido.

Además, los sitios grandes deben considerar la implementación de páginas “hub” o páginas pilar, que funcionan como centros de autoridad y categorización. Estas páginas recopilan enlaces relevantes, explican el tema principal y sirven como vértices que distribuyen fuerza a cientos o miles de piezas secundarias. Un buen hub convierte una arquitectura excesivamente profunda en una estructura equilibrada, lógica y eficiente para bots y usuarios.

Otro componente clave es el control de paginaciones, filtros y parámetros. En sitios masivos, estos elementos pueden generar arquitecturas infinitas y artificiales. La arquitectura ideal combina filtros útiles para el usuario, pero gestionados con reglas SEO claras: qué indexar, qué bloquear, qué consolidar y cómo mantener versiones valiosas a pocos clics de la superficie.

Toma nota: una arquitectura perfecta para sitios grandes es aquella que crece sin romperse. Debe permitir agregar cientos de URLs nuevas sin alterar la profundidad lógica ni afectar al rastreo. Cuando la estructura está bien diseñada, escalar se vuelve natural; cuando no, cada nueva URL es una nueva capa de problemas.

Errores comunes al estructurar la profundidad

La profundidad de una web es uno de los elementos más críticos dentro de la arquitectura SEO, pero también uno de los más mal implementados. Cuando una web distribuye su contenido sin una lógica clara o deja que los niveles crezcan sin control, Google tarda más en rastrear, indexar y entender qué páginas son realmente importantes. Esto provoca pérdida de visibilidad, problemas de autoridad interna y URLs enterradas que nunca llegan a rendir. Estos son los errores más frecuentes que llevan a una profundidad mal estructurada.

Exceso de subniveles y categorías innecesarias

Uno de los errores más comunes es crear jerarquías demasiado profundas, con categorías, subcategorías y sub-subcategorías que no aportan claridad ni valor. Esta estructura fragmentada hace que páginas importantes queden enterradas a tres, cuatro o cinco clics de la home, reduciendo su capacidad de ser rastreadas con frecuencia. Google interpreta estas rutas como señales de baja relevancia, afectando directamente al posicionamiento.

Además, la mayoría de estas subdivisiones son artificiales: podrían resolverse con filtros, etiquetas o enlaces internos sin necesidad de generar nuevos niveles. Cuando cada nuevo contenido empuja a los anteriores a mayor profundidad, el sitio pierde estabilidad arquitectónica. Simplificar y reestructurar evita que el árbol de contenido se convierta en un laberinto.

Paginaciones profundas sin control

Muchos sitios dejan crecer su paginación hasta números ridículos: página 20, 30 o incluso 100 de productos o artículos. Este tipo de estructura crea rutas de acceso demasiado largas, provocando que Google solo rastree las primeras páginas y ignore el resto. Si un contenido valioso cae en paginación profunda, simplemente queda fuera del radar de los bots.

El problema se agrava cuando la paginación no incluye alternativas como «destacados», «más vendidos» o un enlazado interno que devuelva vida a los elementos enterrados. Sin estas rutas adicionales, el bot depende por completo del orden cronológico o del listado infinito, lo que es extremadamente ineficiente para detectar contenido relevante.

Falta de enlazado interno estratégico

Otro error habitual es confiar únicamente en la estructura vertical del sitio y olvidar los enlaces horizontales. Sin enlaces internos relevantes desde categorías principales, hubs temáticos o artículos con autoridad, las páginas profundas quedan aisladas. Esta falta de interconexión hace que Google tarde más en descubrir las URLs y les otorgue menos relevancia a nivel semántico y de autoridad.

Un enlazado interno bien diseñado puede reducir la profundidad real sin necesidad de cambiar la arquitectura física del sitio. Ofrece múltiples caminos hacia una misma URL, refuerza su importancia temática y mejora su posicionamiento. Ignorar este punto equivale a renunciar a una de las palancas SEO más potentes y más baratas de implementar.

Uso incorrecto de filtros y parámetros

Muchos sitios permiten que los filtros generen URLs infinitas, duplicadas o sin valor, lo que aumenta artificialmente la profundidad. Los parámetros pueden crear caminos que Google sigue sin necesidad, consumiendo crawl budget y dejando de rastrear páginas importantes. Esto ocurre especialmente en e-commerce con filtros por color, talla, precio o relevancia.

Cuando no se gestionan con reglas claras noindex, canonical, bloqueo de parámetros o consolidación los filtros se convierten en puertas hacia secciones poco útiles que diluyen la autoridad y desorganizan el mapa del sitio. El resultado es un ecosistema caótico donde la profundidad deja de reflejar importancia real.

Depender únicamente del menú principal

Muchos creadores asumen que mientras algo esté en el menú, Google lo considerará accesible. Pero la profundidad real se define por el número de clics y rutas internas que llevan hacia una URL, no por su lugar en el menú. Puedes tener una categoría visible arriba, pero sus contenidos pueden quedar enterrados en niveles profundos si no existe un enlazado adecuado.

El menú es solo una señal, no un mecanismo suficiente para distribuir autoridad interna. Si no se complementa con enlaces lógicos, breadcrumbs y rutas semánticas, las páginas críticas seguirán sin obtener la fuerza necesaria para competir en posiciones relevantes.

Conclusiones para una web más accesible

Lograr una web accesible desde el punto de vista SEO requiere comprender que la profundidad no es solo un número, sino una señal estructural que comunica a Google qué es prioritario y qué no.

Debemos fijarnos en aquella en la que los contenidos importantes pueden alcanzarse en pocos clics, donde los bots navegan sin fricción y donde la autoridad se distribuye de forma lógica y eficiente. Esto no solo mejora el rastreo y la indexación, sino que incrementa la relevancia y competitividad de las páginas clave.

La clave está en combinar una arquitectura clara con un enlazado interno inteligente. Reducir niveles innecesarios no significa simplificar en exceso, sino equilibrar la información en una estructura que escale sin romperse.

Una web accesible utiliza categorías sólidas, páginas hub bien definidas, breadcrumbs consistentes y rutas de navegación optimizadas. Además, mantiene un control estricto sobre paginaciones, filtros y parámetros para evitar crear profundidad artificial o URLs sin valor.

Un sitio realmente accesible prioriza la experiencia del usuario: si un contenido cuesta encontrarlo manualmente, Google también tendrá problemas para rastrearlo. Por eso, la accesibilidad SEO y la usabilidad real van de la mano. Una arquitectura lógica no solo hace que el bot llegue antes a las páginas relevantes; también ayuda a los visitantes a orientarse, convertir mejor y consumir contenido de forma más fluida.

Una web accesible combina estructura, coherencia y propósito. No se trata solo de reducir clics, sino de diseñar un ecosistema donde cada URL tenga su lugar, su función y su relación dentro del conjunto. Cuando la profundidad está optimizada, la web se vuelve más fácil de rastrear, más fácil de comprender y, sobre todo, más fácil de posicionar.